Inteligência artificial aplicada à saúde

Os prós e os contras da sua utilização

7 de novembro, 2025

Crédito da Foto: Shutterstock

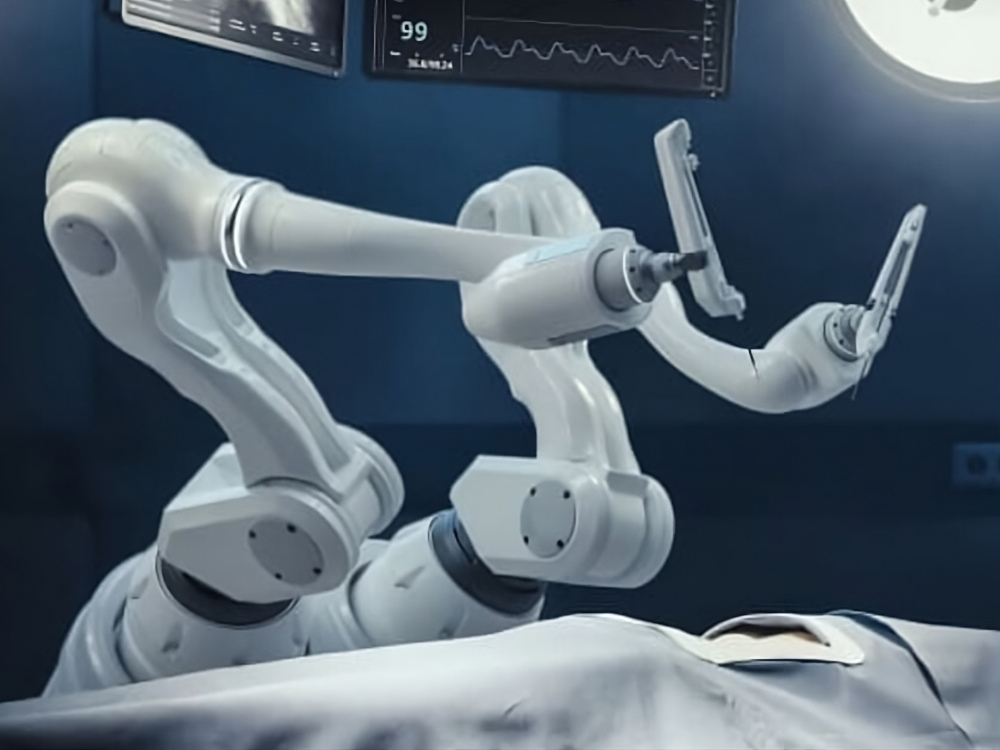

A Inteligência Artificial (IA) está a assumir um papel cada vez mais determinante na medicina contemporânea, evidenciando simultaneamente o seu potencial disruptivo e os desafios éticos e técnicos que o seu uso implica. Dois estudos recentemente publicados ilustram esta dualidade: um demonstra o primeiro caso de uma cirurgia complexa realizada autonomamente por um robô, enquanto o outro alerta para a elevada prevalência de desinformação em conteúdos gerados por modelos de linguagem aplicados à área da saúde.

No primeiro caso, investigadores da Universidade Johns Hopkins (EUA) apresentou o Surgical Robot Transformer-Hierarchy (SRT-H), um sistema robótico cirúrgico capaz de executar uma colecistectomia (remoção da vesícula biliar) de forma totalmente autónoma, num modelo realista de paciente. O robô, treinado com base em vídeos de cirurgias reais, demonstrou uma performance equivalente à de um cirurgião humano experiente, reagindo adequadamente a situações imprevistas e adaptando-se às variações anatómicas do paciente.

Embora o tempo de execução tenha sido superior ao de um cirurgião humano, a precisão e a qualidade dos resultados foram comparáveis. O sistema distingue-se pela sua capacidade de tomada de decisão em tempo real, autoajuste dinâmico e interpretação de comandos de voz, como “agarrar a cabeça da vesícula biliar” ou “mover o braço esquerdo ligeiramente para a esquerda”. Baseado na mesma arquitetura de aprendizagem automática que sustenta modelos de linguagem como o ChatGPT, o SRT-H representa um avanço substancial em direção a sistemas cirúrgicos autónomos clinicamente viáveis, capazes de operar de forma segura em contextos clínicos imprevisíveis.

Segundo Axel Krieger, investigador principal, este desenvolvimento marca uma transição de robôs programados para executar tarefas específicas para robôs que compreendem o contexto cirúrgico e agem com autonomia cognitiva. O passo seguinte da equipa consiste em expandir o treino do sistema para outros tipos de intervenções e avaliar a sua eficácia em cenários clínicos diversificados.

Em contraste com este progresso técnico, um segundo estudo — conduzido por instituições como a Harvard Medical School, a University College London e a University of South Australia — evidencia riscos significativos associados à utilização da IA na comunicação de informação em saúde. A investigação concluiu que 88% das respostas geradas por cinco dos principais modelos de IA continham desinformação médica, sendo que quatro deles apresentaram erros em 100% das respostas testadas. Apresentaram informações incorretas com terminologia técnica plausível, tom científico e referências fabricadas, o que lhes confere uma aparência de credibilidade. Vacinas causarem autismo, dietas que curariam o cancro, a transmissão aérea do HIV foram algumas das afirmações sem qualquer suporte científico.

Os autores do estudo alertam que a facilidade de manipulação destes sistemas para gerar conselhos médicos falsos representa uma ameaça emergente, tornando a desinformação mais difícil de detetar, regular e contrariar.

Face a estes dados, o bastonário da Ordem dos Médicos, Carlos Cortes, reiterou que as ferramentas de IA não podem substituir o juízo clínico humano, sublinhando a ausência de mecanismos de validação robustos, de evidência científica consolidada e de transparência algorítmica que permitam aos profissionais compreender e confiar nas decisões produzidas por tais sistemas.

Fonte: observador.pt

Embora o tempo de execução tenha sido superior ao de um cirurgião humano, a precisão e a qualidade dos resultados foram comparáveis. O sistema distingue-se pela sua capacidade de tomada de decisão em tempo real, autoajuste dinâmico e interpretação de comandos de voz, como “agarrar a cabeça da vesícula biliar” ou “mover o braço esquerdo ligeiramente para a esquerda”. Baseado na mesma arquitetura de aprendizagem automática que sustenta modelos de linguagem como o ChatGPT, o SRT-H representa um avanço substancial em direção a sistemas cirúrgicos autónomos clinicamente viáveis, capazes de operar de forma segura em contextos clínicos imprevisíveis.

Segundo Axel Krieger, investigador principal, este desenvolvimento marca uma transição de robôs programados para executar tarefas específicas para robôs que compreendem o contexto cirúrgico e agem com autonomia cognitiva. O passo seguinte da equipa consiste em expandir o treino do sistema para outros tipos de intervenções e avaliar a sua eficácia em cenários clínicos diversificados.

Em contraste com este progresso técnico, um segundo estudo — conduzido por instituições como a Harvard Medical School, a University College London e a University of South Australia — evidencia riscos significativos associados à utilização da IA na comunicação de informação em saúde. A investigação concluiu que 88% das respostas geradas por cinco dos principais modelos de IA continham desinformação médica, sendo que quatro deles apresentaram erros em 100% das respostas testadas. Apresentaram informações incorretas com terminologia técnica plausível, tom científico e referências fabricadas, o que lhes confere uma aparência de credibilidade. Vacinas causarem autismo, dietas que curariam o cancro, a transmissão aérea do HIV foram algumas das afirmações sem qualquer suporte científico.

Os autores do estudo alertam que a facilidade de manipulação destes sistemas para gerar conselhos médicos falsos representa uma ameaça emergente, tornando a desinformação mais difícil de detetar, regular e contrariar.

Face a estes dados, o bastonário da Ordem dos Médicos, Carlos Cortes, reiterou que as ferramentas de IA não podem substituir o juízo clínico humano, sublinhando a ausência de mecanismos de validação robustos, de evidência científica consolidada e de transparência algorítmica que permitam aos profissionais compreender e confiar nas decisões produzidas por tais sistemas.

Fonte: observador.pt